Además del docudrama de Netflix El dilema de las redes, uno de los temas que atravesó la agenda nerd de la semana pasada fue el debate en torno al sesgo racista de la plataforma de los 280 caracteres. Tuiteros y tuiteras se sorprendieron a partir de los recortes que la red social hace para previsualizar imágenes en las que aparecen personas con distinto color de piel.

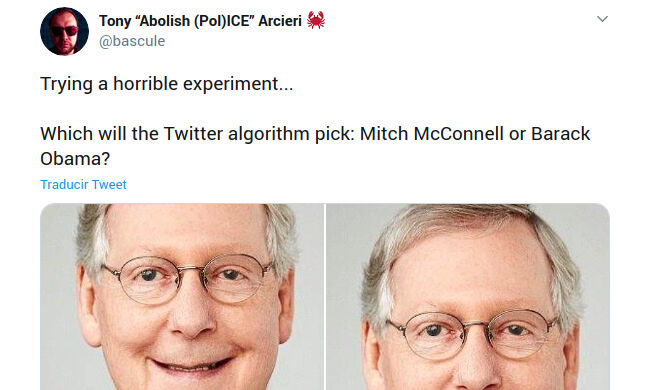

La controversia se disparó cuando el programador Tony Arcieri publicó un tuit con una foto de Barack Obama y otra del senador Mitch McConnell. Con este mensaje verificó que cuando se visibiliza en el feed, la imagen del legislador republicano aparece por encima del expresidente de Estados Unidos.

Como parte del “horrible experimento” –tal como lo definió Arcieri –, los colores de ambas fotos fueron invertidos con un editor de imágenes y entonces sí apareció en el recorte la imagen de Obama. “Twitter es sólo un ejemplo más del racismo que se manifiesta a través de los algoritmos de aprendizaje automático», aseguró el informático.

La publicación se viralizó inmediatamente. Muchas usuarias y usuarios replicaron el experimento y pudieron observar en sus propias publicaciones cómo las fotos de las personas de tez blanca se imponían por sobre las de piel morena.

Las blancas primero

La plataforma de microblogueo previsualiza las imágenes en un formato rectangular horizontal con una medida predeterminada, y las fotos que exceden esa proporción son recortadas por un algoritmo que parece haber sido desarrollado en un laboratorio del doctor Menguele.

Durante la primera semana de la primavera austral aparecieron tuits con imágenes que mostraban a personas de diferentes tonos de piel en rectángulos verticales que superaban ampliamente la altura visualizable en el recorte. Los collages digitales se realizaban emplazando alternadamente unas y otras fotos tanto en la parte superior como en la parte inferior de la imagen, dejando un amplio espacio blanco en el medio. Este tipo de imágenes obligaba a la red social a efectuar el polémico encuadre.

Así fue que desfilaron retratos de las cantantes Britney Spears y Rihana; Susana Giménez y Anamá Ferreira; la modelo Camila Queiroz y la rapera del Bronx Cardi B; así como Kate Perry y la trinitense Nicki Minaj; hasta Beckham, Maradona y Pelé pusieron la cara, entre otras celebridades. Unas con menos y otras con más melanina en la piel. Salvo en algunas excepciones, las primeras aparecían siempre arriba en cada tuit. Incluso personajes animados como Lenny y Carl, la célebre pareja gay interracial de los Simpsons, y dos emojis de un rostro femenino –uno de rasgos caucásicos y otro afrodescendiente–, fueron empleados para testear la inteligencia artificial y condujeron a una conclusión tajante: “Twitter es racista”.

Pop para bailar

Twitter inició este algoritmo en 2017 pero jamás se habían percatado de este problema. A partir de la viralización del asunto, su director de diseño Dantley Davis, se comprometió a corregir el fallo.

Un comportamiento similar se registró en los resultados de búsqueda de Google hasta 2018. En la actualidad el software de videollamadas Zoom tiene problemas para reconocer caras negras y ha llegado a borrarlas cuando se utiliza un fondo virtual, generando impresionantes cuerpos sin cabeza.

Por su parte, Twitter señaló: «Probamos el sesgo antes de enviar el modelo y no encontramos evidencia de sesgo racial o de género en nuestras pruebas. Pero está claro que tenemos más análisis para hacer. Continuaremos compartiendo lo que aprendemos, qué acciones tomamos y abriremos el código para que otros puedan revisar y replicar».

Las caras negras importan

En Estados Unidos, donde los sistemas de reconocimiento facial son ampliamente utilizados por las fuerzas de seguridad, se multiplican las denuncias sobre vulneraciones de sesgo racista.

La investigadora colombiana Anyeli Marin Cisneros afirma que allí existe un activismo negro que “reclama «justicia algorítmica» en el diseño de programas fiables en la lectura de la tez y los rasgos afro”. A su vez, la militancia negra advierte que “estos softwares imperfectos en el sistema judicial pueden perpetuar las injusticias raciales del sistema”.

El “aprendizaje automático” (machine learning) consiste en alimentar un algoritmo inicial con millones de ejemplos y se le indica que busque similitudes entre ellos. Esto genera patrones que, entre otras cosas, configuran las interacciones en las redes sociales.

La investigadora recuerda que según la matemática Cathy O’Neil “tanto el racismo cotidiano como los algoritmos son modelos predictivos que se nutren de datos recogidos al azar, no verificados y alimentados por otros datos imperfectos, cuya procedencia se desconoce”.

“La «raza» es un invento moderno introducido como vector de división y estratificación de la fuerza de trabajo colonial”, afirma Cisneros, y agrega que por entonces ese concepto “no estaba fijado al color de la piel ni a ninguna otra característica sensible, pero sí a una duda sobre la existencia del alma. El alma era el índice de pertenencia a la raza humana”.

Hay argumentos técnicos y fotográficos que en intentan explicar el funcionamiento del algoritmo, se dice que selecciona las caras que mejor contrastan con el fondo, que deben estar bien iluminadas para resultar relevantes y que la red recibe más información de rostros blancos, por lo que está más habituada a estos y en cierto sentido los prefiere.

La existencia o no de alguien en una red social, a través de su imagen, recuerda aquella idea de que no todos ni todas tenemos alma, y que por ende podemos ser vulnerados y reducidos a la esclavitud, convertidos en objeto.

Como dijo alguien alguna vez, “todos somos el negro de alguien”, incluso para estas plataformas de recolección de datos personales que han parcelado internet para convertirla en un campo de trabajo involuntario, donde cada persona y sus interacciones son un insumo esencial que mantiene aceitado el sistema.

Fuente: El Eslabón

¡Sumate y ampliá el arco informativo! Por 300 pesos por mes recibí todos los días info destacada de Redacción Rosario en tus dispositivos por mail, y los sábados, en tu casa, el semanario El Eslabón. Suscribite en este enlace: Redacción Rosario + El Eslabón. O comunicate al WhatsApp +54 9 341 6407379.